这个问题蛮关键的,我补充回答一下,其实这是一个特征表达力的问题,传统方法特征表达力,不如Deep Learning的多层学习得到的更有效果的表达。举个例子,假定有一种疾病,这种疾病容易在个高且胖的人群,以及个矮且瘦的人群中易感。那么任意从给一个特征角度上看,比如肥胖,那么胖的这部分人中,得此病的概率为50%,不胖的也是50%,那么'胖'这个特征没有表达力。

用学术上的术语来说,身高和体型是两个Marginally independent的变量,即如果观察到了他们产生的结果,他们就不独立了。也就是如果身高和体型在用于检测这种疾病的时候,他们就不独立了,因此需要有一种特征表示的方式来表示他们的这种不独立性,能够combine他们以形成更好的特征。而这种更结构化的特征,需要大量的语料才能training到位。而独立性的特征,往往少部分语料就可以获得很好的结果,但随着语料数量的提高,无法observe到结构化的特征,因此更多的语料就浪费了。我们都知道这是AI领域的XOR问题,也就是二层 神经网络就能求解,换言之,多层神经网络mining出来更好的特征。

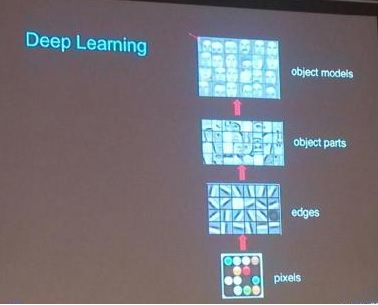

接着Ng也直观的展示了,从像素级特征(表达力最弱)到edges级特征,直到object级特征。 从edges特征大家看到的这个形式,其实是深度神经网络的edges中的一个小块,就是input layer到第一个hidden layer之间的一组边(如果是RBM 的话)或者是第一个hidden layer到output layer的一组边,这组边可以理解成training的成果。而hidden layer是一个sparse coding的向量,用来combine不同组的边来还原出input layer。

因此可以看到,通过深度学习的处理,无需tagged data,通过自学习的方式,就可以做到特征的表达力从像素级,提高到了 object models,多么美妙啊,难怪Ng用了Amazing这个词,而且再一次地露出了特有的微笑。

2)Deep Learning存在的问题

Ng提到了,通常学生试验在10 million connections这个水平,因为在大已经超出计算的能力,但如果采用并发的方法,160000万个CPUs的情况下,可以达到1 billion connections这个水平。如果采用特制的GPU来计算,可以达到10 billion connections的水平。

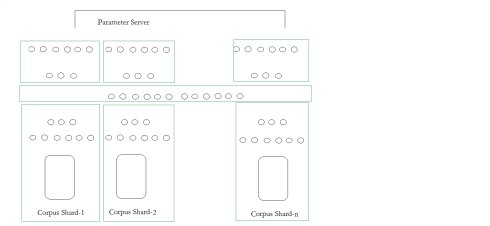

从我自己的实验结果看,目前做千万connection是没问题的,时机成熟我就开放出来,但受限于CPU在向量计算的劣势,再大的话,每一轮训练的时间就会大大提高,变得不可计算,而分布式Parameter server的搞法,虽然能够第一步把语料shard一下,然后各自训练,到了最高层用类似transform learning的法子再combine(这段话是我自己猜测的,Ng的报告这里我没听太懂,图片是按照记忆画出)

我个人的理解,就是一个巨大语料切成n个部分,每个部分产生表达力强的特征,而这些表达力强的特征在一个阶段,就是那个长条哪里进行combine,也就是这个hidden layer可以很好的表达来自不同shard的特征,最后在展开各层,用不同shard上的tagged data来进一步调整每条边的权重。

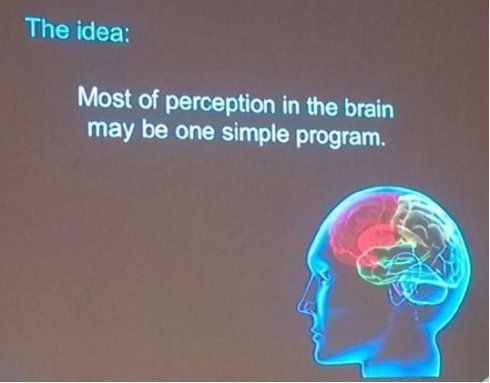

3)Deep Learning的Idea

这个可能没什么可说的,但我认为很重要,这段话不难翻译,人脑中大部分感知器是一个非常简单的计算过程。但通过组合可以达到很高的理解力。但问题是如何组合,感知的过程如何从低级阶段到高级阶段,从明暗,色彩的感知,到人类喜怒哀乐的情感,整个过程的每一步可能都是naive得,但整个认知链条的末端一定是语义的,有感情的,上升到概念的。另外,通常还有一个体会,比如看一本小说,脑海中就能自然浮现画面,可见不同神经感知器也不是完全独立的,而是彼此联系的。

4)Deep Learning的一些成果

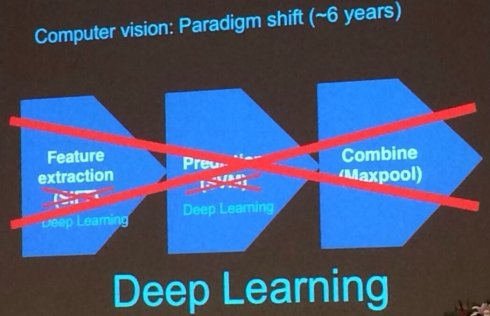

报告中提到很多成果,特别是提到了图像识别中,在DL面前,SIFT特征提取算法弱爆了,我还是为Ng的自信和霸气,略震了一下。按照常规,学术界的同志应该谦虚,尊重下老前辈,尊重下传统的。。

后来的提问环节,也有同学问到,那些old算法框架怎么办呢?Ng说无论怎样,这就是科学技术的趋势,当一个东西产生明显效果后,越来越多的方法会采用这些新方法,而传统方法,不是说研究者就立马到zero,但的确会fewer and fewer。当时我心里想,无论如何如何,总得有留下少部分坚守的同志,没准10年后翻身也难说,但大部队应该扑新方法的。

5)未来趋势

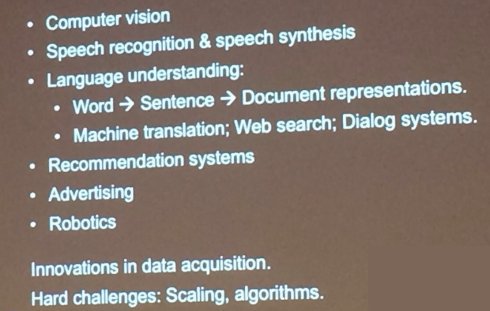

未来趋势基本是一些喜闻乐见的东西,没什么新意,包括后来提问环节也有人提问,让Ng透露未来的一些计划。Ng说未来的事情总是千变万化的,如果真是希望了解产业界的一些计划,可以来百度打工,和最优秀的工程师一起做事。

提问环节有很多有趣的话题,比如有人问百度,以及Andrew Ng本人对Spark的评价,Ng回答到,百度用了很多开源工具,但机器学习的很多问题太Uniq了,太特殊了,而Spark这种通用的东西很难满足需求,当然不是说SPark不好,只是Ng本人也很少用(用了Less这个词汇)。还有包括为什么效忠百度,Ng说了三个原因,第一他认为机器学习是Transform世界,Transform互联网的一种方式,相比coursera更加感兴趣。第二百度拥有大量优秀的科学家,高质量的同事,比如余凯,张潼,李伟同志等等。第三,百度拥有大量的data, 还有个同学要DL的Reading List,Ng给了个这个:http://deeplearning.stanford.edu/wiki/index.php/UFLDL_Recommended_Readings,还说里面有邓侃号召中国青年的贡献在里面。另外根据网友@

fiona_duan的反馈。最后Andrew提到的是他出生于香港,长在英国和新加坡,之后在美求学和生活。他和媳妇都在美国。他媳妇叫Carol Reiley. Carol 是约翰·霍普金斯大学的医学博士以及在读计算机博士,研究方向是生物医学方向的机器人应用。

整个报告大概就是这样,我的理解也难免偏颇,水平难免有限,但我坐在第一排,努力的听每一个细节,并快速思考,能量消耗蛮大的,另外就是百度来了几个美女,看上去比较有知识,跑前跑后的拍照。

上次在清华的报告,这里也一并推荐阅读下:

http://blog.sina.cn/dpool/blog/s/blog_593af2a70101bqyo.html?vt=4